태양광 농장을 지도에 찍어본 엔지니어

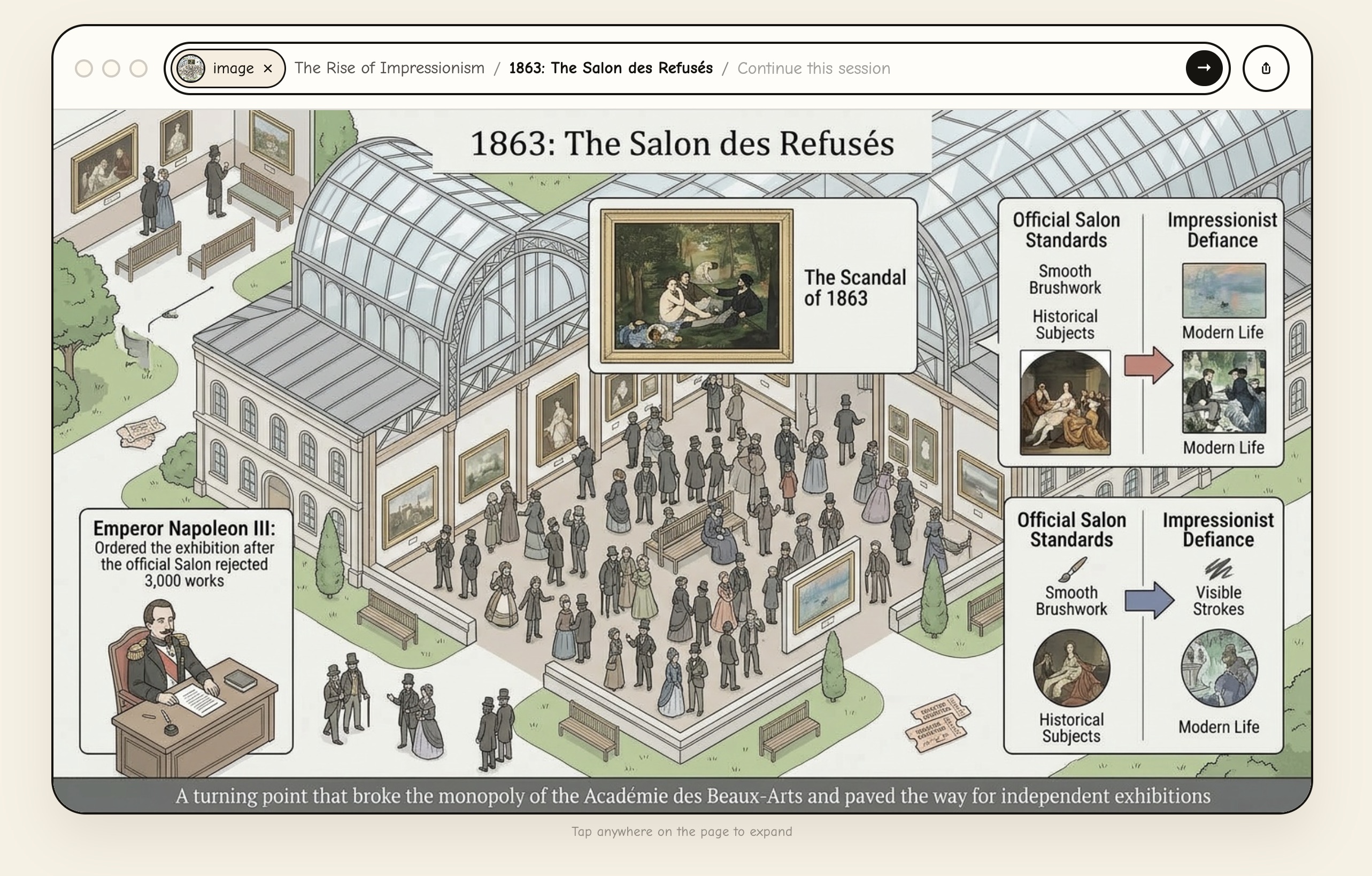

데이터 엔지니어 Mark Litwintschik이 재밌는 프로젝트를 공개했어요. 바로 미국 전역에 설치된 태양광 패널 340만 장의 위치와 정보를 분석한 블로그 포스트예요. 제목은 간단하게 '3.4M Solar Panels'인데, 내용을 들여다보면 공공 데이터와 오픈소스 지리정보 도구(GIS)를 어떻게 엮어서 의미 있는 인사이트를 뽑아내는지 보여주는 훌륭한 사례거든요.

요즘 한국에서도 태양광 이야기 많이 나오잖아요. 농지 위에 패널 세우는 문제, 전력망 수용 한계, RE100 같은 이슈들이 터지는데, 정작 우리가 이런 걸 데이터로 얼마나 잘 분석하고 있나 생각해보면 좀 부족하거든요. 이 프로젝트는 한 명의 엔지니어가 공개 데이터만으로 어디까지 파헤칠 수 있는지를 보여줘요.

340만 장을 어떻게 다루는가

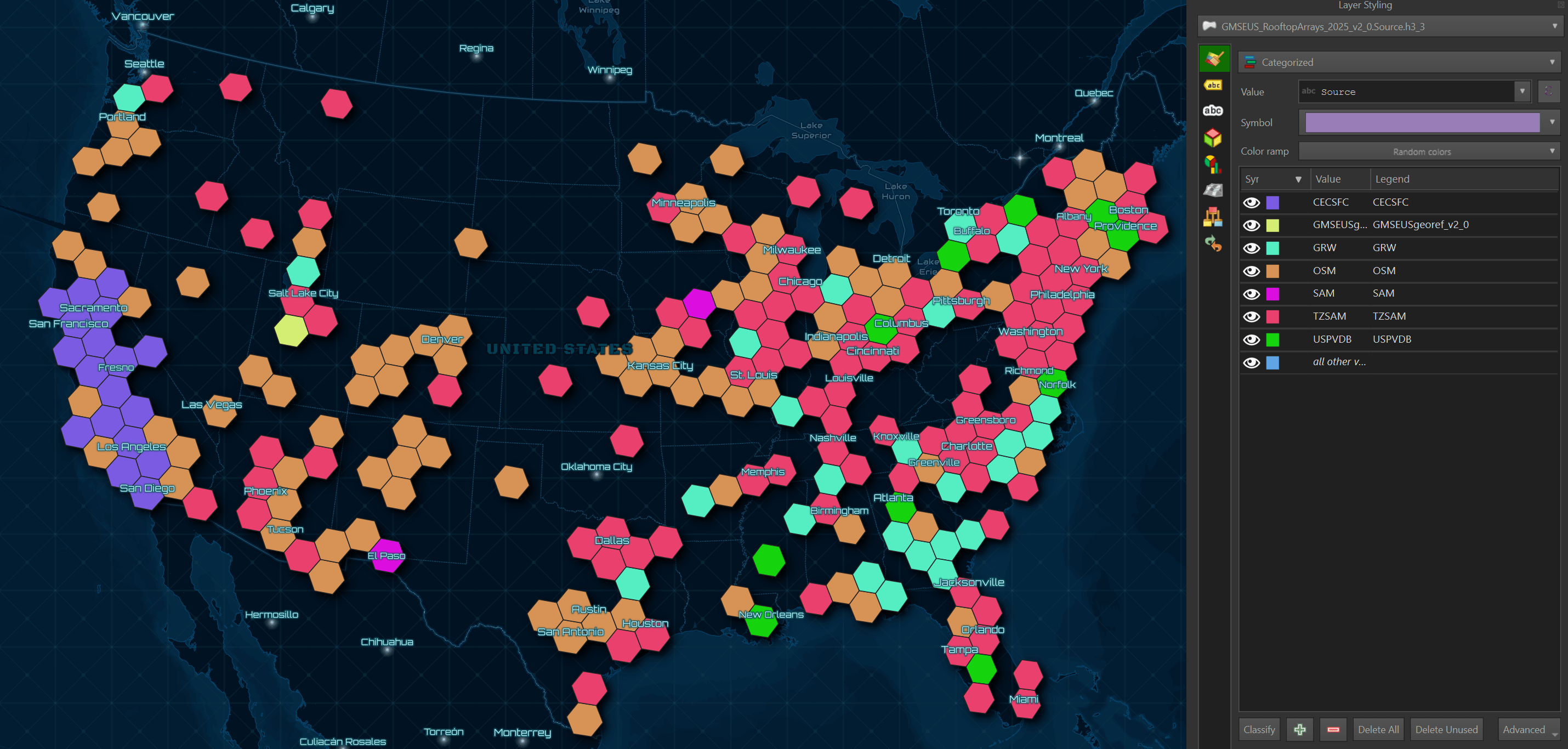

먼저 데이터의 출처가 흥미로워요. 미국 로렌스 버클리 국립연구소 같은 기관이 USPVDB(United States Photovoltaic Database) 같은 공공 데이터베이스를 운영하고 있고, 여기엔 상용 규모 태양광 발전소의 위경도, 용량(MW), 가동 시작일, 패널 제조사 같은 정보가 정리돼 있어요. 글쓴이는 여기에 추가로 위성 이미지 기반으로 추출한 패널 단위 폴리곤 데이터까지 붙여서, 발전소 단위가 아니라 패널 하나하나의 다각형 윤곽을 340만 개 수준으로 다뤄요.

이런 규모의 지리 데이터를 처리할 때 도구 선택이 중요한데요, 이 글에서는 DuckDB와 그 공간 확장 기능(spatial extension)을 많이 써요. DuckDB가 뭐냐면, SQLite처럼 파일 하나로 동작하지만 컬럼 기반 처리로 분석 쿼리가 엄청 빠른 임베디드 데이터베이스예요. 여기에 Parquet 포맷으로 압축된 지리 데이터를 얹고, GeoPandas나 QGIS 같은 도구로 시각화해서, 노트북 한 대에서 수백만 행의 공간 조인을 돌려요. 예전 같으면 PostGIS 깔고 서버 세팅해야 했을 일을 로컬에서 단일 프로세스로 처리하는 거죠.

성능 수치도 구체적으로 나와요. 340만 개 폴리곤의 면적 계산, 주 경계와의 공간 조인, 발전 용량별 집계 같은 쿼리가 모두 초 단위로 끝난다는 식이에요. 몇 년 전만 해도 상상하기 힘들었던 속도죠.

결과로 드러나는 미국 태양광 지도

분석 결과가 꽤 흥미로워요. 예상대로 캘리포니아와 텍사스, 플로리다가 압도적으로 많고, 일조량뿐 아니라 토지 가격과 송전망 접근성이 영향을 크게 준다는 게 데이터로 보여요. 반면 뉴욕 같은 동북부는 인구 대비 설치량이 적은 편이고요. 또 재밌는 건 사막 한가운데 수십 MW급 대형 발전소 한 방으로 전체 설비용량이 확 늘어나는 지역이 있는가 하면, 주거용 지붕 태양광이 분산되어 누적되는 지역도 있어서 패턴이 지역마다 다르다는 거예요.

이런 공간 분석이 왜 중요하냐면, 전력 수요지와 공급지의 거리가 곧 송전 손실과 비용으로 이어지거든요. 태양광이 많이 깔려도 전기를 필요로 하는 도시까지 보내는 인프라가 따라가지 못하면 말짱 도루묵이에요. 실제로 미국 일부 지역에선 태양광 설비가 너무 많아서 낮에는 전기 가격이 마이너스가 되기도 하죠.

데이터 엔지니어링 관점의 맥락

비슷한 사례들과 비교해볼 만해요. 구글의 Project Sunroof는 위성과 머신러닝으로 지붕별 태양광 잠재량을 추정했고, OpenStreetMap 커뮤니티는 수동으로 태양광 패널을 태깅해왔어요. Mark의 이번 작업은 이런 공공·오픈 데이터를 로컬 분석 스택(DuckDB + Parquet + 파이썬)으로 엮었다는 점에서 요즘의 'modern data stack' 축소판을 보여줘요. 클라우드 DW 없이도 개인이 수백만 행의 공간 데이터를 다룰 수 있다는 증명이죠.

한국 개발자가 얻을 수 있는 것

첫째, 공공 데이터를 다루는 감각을 키우기 좋은 글이에요. 한국에도 공공데이터포털, 전력거래소, 국토정보플랫폼 같은 곳에 풍부한 데이터가 있는데 실제로 이걸 엮어서 분석해본 사람은 많지 않거든요. 이 글의 워크플로우를 그대로 따라 하면서 데이터셋만 한국 것으로 바꿔보면 훌륭한 포트폴리오 프로젝트가 돼요.

둘째, DuckDB + 공간 확장은 요즘 실무에서 정말 유용한 조합이에요. PostGIS나 BigQuery가 과하다 싶은 중간 규모 분석에서 로컬로 빠르게 돌려볼 수 있거든요. 회사에서 지리 데이터 다룰 일이 있다면 한번 써보길 강력 추천해요.

셋째, 에너지·ESG 분야 데이터 분석은 앞으로 꾸준히 수요가 늘 영역이에요. 탄소배출권, 재생에너지 인증서(REC), 지역별 탄소중립 이행 같은 것들이 전부 지리·시계열 데이터 분석 문제거든요.

마무리

공공 데이터 + 오픈소스 도구 + 개인 노트북, 이 조합만으로 국가 단위 인프라를 분석할 수 있는 시대예요. 여러분은 관심 있는 분야의 공공 데이터를 한번 들여다보신 적 있나요? 한국 태양광 데이터로 비슷한 분석을 해본다면 어떤 질문을 던져보고 싶으세요?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공