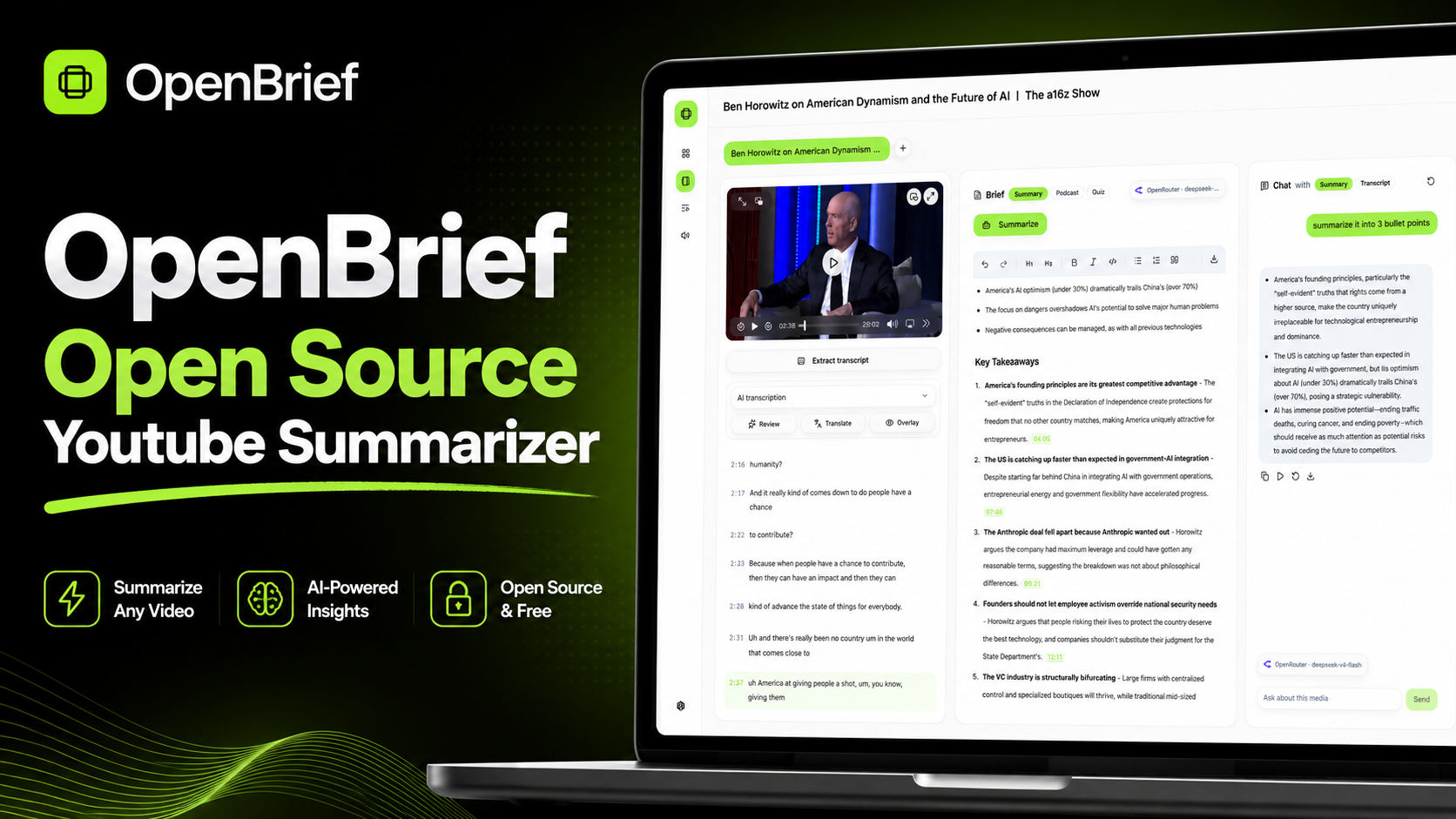

유튜브 영상도 내 컴퓨터에서 요약하는 시대, OpenBrief 살펴보기

## 영상 요약, 왜 굳이 로컬에서? 긴 유튜브 강의나 컨퍼런스 영상을 다 볼 시간이 없을 때, 요즘은 AI한테 요약을 맡기는 분들이 많아졌어요. 다만 대부분의 영상 요약 서비스는 클라우드 기반이에요. 영상 링크를 입력하면 서버에서 다운로드하고,...

프로그래밍 책을 더 이상 펼치지 않는 시대, 우리는 무엇을 잃고 있을까

## 갑자기 책장이 조용해진 이유 예전엔 새로운 기술을 배울 때 가장 먼저 하는 일이 두꺼운 기술 서적을 사는 거였어요. O'Reilly의 동물 그림이 그려진 책이나 "프로그래밍 OOO" 같은 제목의 책을 책상에 쌓아두고, 챕터별로 읽어가면서 코...

AI가 macOS 커널 취약점을 찾았다: Claude가 발견한 CVE-2026-28952의 의미

## AI가 보안 연구자가 되는 시대 보안 업계에 꽤 상징적인 사건이 하나 일어났어요. Apple이 공식 보안 업데이트 페이지에서 **CVE-2026-28952라는 macOS 26.5 커널 취약점**을 공개하면서, 이 취약점을 발견한 주체로 "Cla...

"제조된 일상감" — 우리는 왜 스마트폰을 마법이 아니라 당연한 물건으로 느낄까

## 이상한 질문 하나 생각해 보면 좀 이상해요. 우리는 지금 손바닥만 한 기기 하나로 지구 반대편 사람과 영상 통화를 하고, AI한테 코드를 짜달라고 부탁하고, 위성 GPS로 길을 찾아요. 30년 전 사람이 보면 분명 마법이라고 했을 일들이에요. ...

테크 뉴스를 읽는 당신,

직접 만들어볼 준비 되셨나요?

17가지 수익 모델 실습 · 144+ 강의 · 자동화 소스코드 제공

노르웨이가 화웨이 플래시 2PB로 자국 LLM을 학습시키는 진짜 이유

## 무슨 일이 있었나 노르웨이가 자국 LLM(거대 언어 모델) 학습용으로 2페타바이트(PB)짜리 화웨이 플래시 스토리지를 도입했다는 소식이 나왔어요. 2페타바이트면 일반적인 1TB 하드디스크 2,000개에 해당하는 어마어마한 용량인데요, 더 흥...

AI가 만들어낸 가짜 errno 값들, 유닉스 시스템 콜의 위험한 환각

## errno가 뭐고, 왜 이게 중요할까요? C나 시스템 프로그래밍을 해본 분이라면 **errno**라는 이름이 익숙할 거예요. 유닉스 계열 시스템에서 시스템 콜(예: open, read, write 같은 OS 호출)이 실패하면, 실패 원인을 숫자...

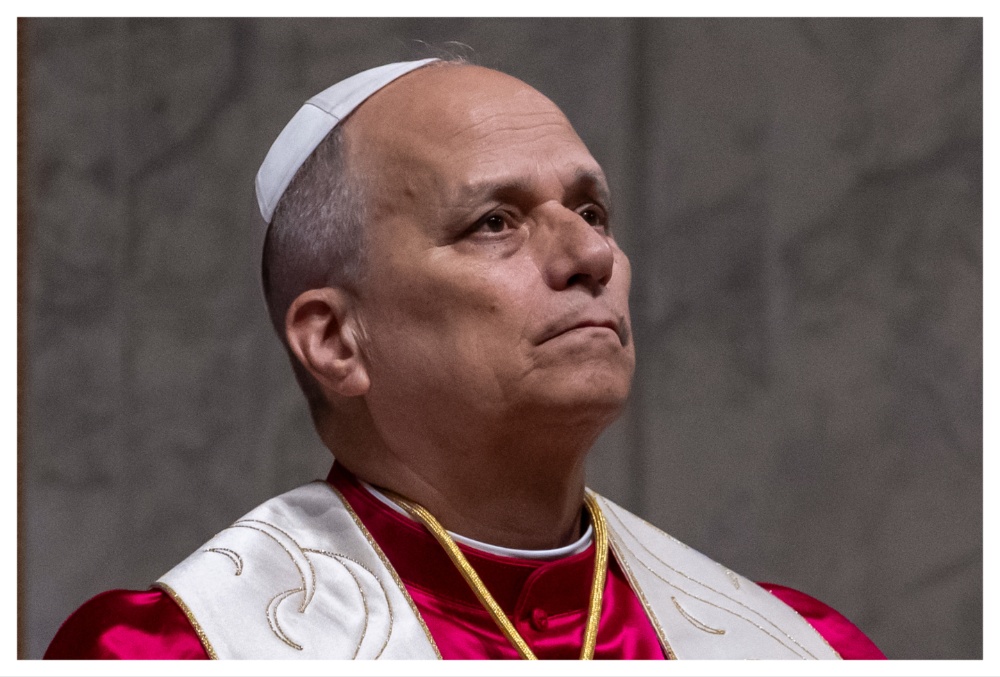

교황 레오의 AI 경고: "소수 기업이 통제하는 불투명한 AI는 새로운 비인간화를 부른다"

## 무슨 일이 있었나 2026년, 새로 즉위한 교황 레오 14세가 첫 회칙(encyclical)에서 인공지능 문제를 정면으로 다뤘어요. 회칙이 뭐냐면, 가톨릭 교회의 가장 권위 있는 공식 문서예요. 교황이 전 세계 14억 가톨릭 신자와 인류 전...

교황이 AI에 대해 말했어요, 그런데 왜 우리가 귀 기울여야 할까요?

## 교황의 첫 회칙이 "AI"를 다뤘다는 것 뉴스 제목만 보면 좀 의아할 수 있어요. "교황과 AI?" 종교 지도자가 기술 얘기를 하는 게 어떤 의미가 있을까 싶죠. 그런데 이번 일은 단순한 코멘트가 아니에요. **교황 레오 14세의 첫 회칙(...

구글이 더 이상 예전 구글이 아닌 시대, 검색 대안 6가지를 살펴봐요

## 검색이 이상해진 거, 여러분도 느끼셨죠? 요즘 구글에 뭔가 검색하면 예전 같지 않다는 느낌, 다들 한 번쯤은 받아보셨을 거예요. 첫 화면 절반은 광고로 채워져 있고, 그 다음엔 AI가 요약해서 던져주는 답변이 떡하니 자리잡고 있죠. 정작 우...

Claude는 당신의 아키텍트가 아니다 - AI에게 시스템 설계를 맡기면 안 되는 이유

## "Claude, 우리 시스템 아키텍처 좀 짜줘"의 함정 요즘 개발자 사이에서 Claude나 GPT를 코딩 파트너로 쓰는 게 자연스러워졌어요. 코드를 짜달라고도 하고, 리팩터링도 시키고, 심지어 "이 시스템 어떻게 설계하면 좋을까?"라고 아키...

"어린 시절의 컴퓨팅" - 제약이 만든 진짜 학습에 대한 회고

## 느린 컴퓨터가 오히려 좋은 선생이었다 Susam Pal이라는 개발자가 자신의 블로그에 쓴 "Childhood Computing"이라는 글이 잔잔한 공감을 일으키고 있어요. 이 글은 인도에서 자란 한 개발자가 1990년대 후반~2000년대 초반,...

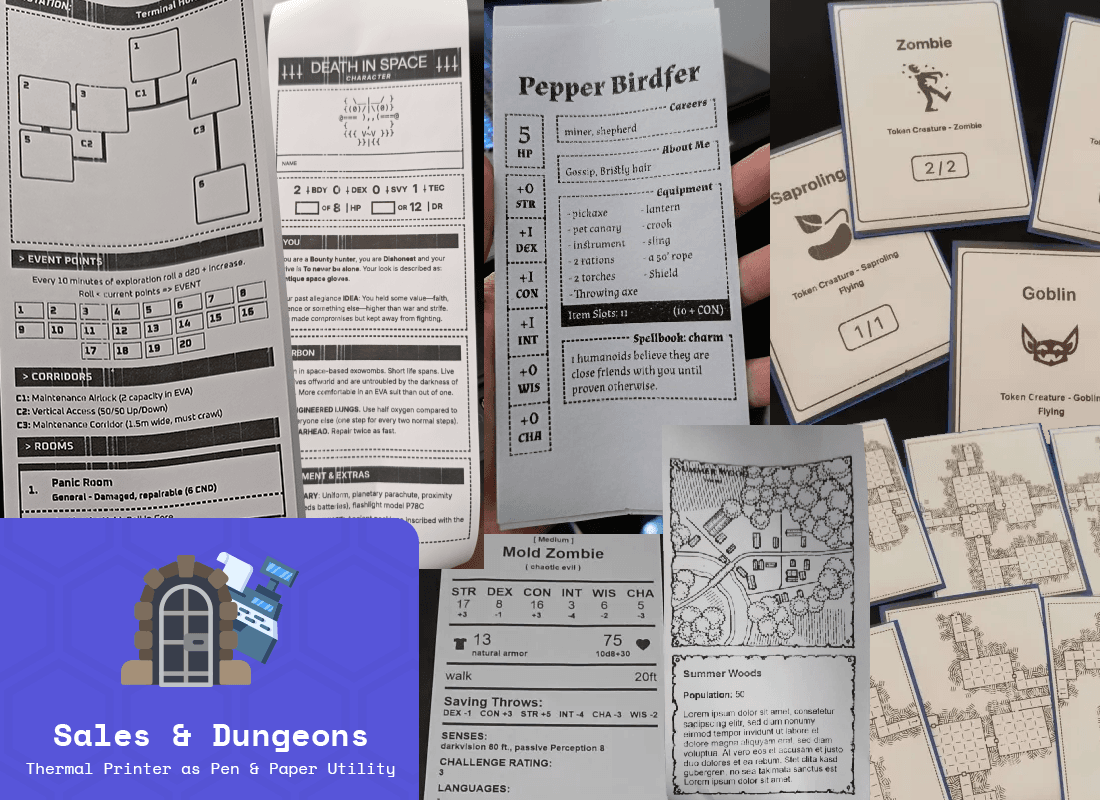

영수증 프린터로 던전 앤 드래곤을? 개발자 취미가 만든 도구

## "이런 생각을 어떻게 했지" 싶은 사이드 프로젝트 가끔 개발자들의 사이드 프로젝트를 보면 "이런 생각을 어떻게 했지?" 싶은 것들이 있어요. 'Sales and Dungeons'라는 프로젝트가 딱 그런 경우예요. 이름부터가 'Dungeons...

파일시스템을 '지웠더니' 47배 빨라졌다: microsandbox의 OCI 이미지 최적화 이야기

## 빨리하려면 줄이지 말고, 아예 없애라 성능 최적화 글을 읽다 보면 "이걸 줄였더니 N배 빨라졌다" 같은 이야기가 흔하잖아요. 그런데 microsandbox 팀이 쓴 이 글의 제목은 좀 충격적이에요. **"파일시스템을 삭제했더니 47배 빨라졌...

마이크로소프트, 사내 Claude Code 라이선스 회수 시작 — 코딩 AI 전쟁의 새 국면

## 무슨 일이 일어난 건가요 마이크로소프트가 자사 직원들이 쓰던 **Claude Code 라이선스를 하나씩 회수하기 시작했어요.** Claude Code가 뭐냐면, Anthropic이라는 회사가 만든 AI 코딩 도구거든요. 터미널 안에서 자연어...

AI는 정말 돈을 벌고 있을까? 수익성 대시보드가 던지는 질문

## ChatGPT 열풍 3년, 그런데 돈은 누가 벌고 있을까요? 2022년 말 ChatGPT가 등장한 이후, AI는 모든 산업의 화두가 됐어요. 엔비디아 시가총액은 천정부지로 치솟았고, OpenAI는 수천억 달러 가치로 평가받고 있죠. 그런데 정작...

DeepSeek V4 Pro, 할인가를 영구화하다 — 가격 경쟁의 새 국면

## 무슨 일이 있었나요 DeepSeek이 자사의 플래그십 모델인 **V4 Pro의 가격 할인을 영구적으로 적용**한다고 발표했어요. 원래는 출시 기념 프로모션으로 한시적으로 내려놓은 가격이었는데, 이걸 그대로 정가로 굳혀버린 거죠. 단순히 "세...

"LLM이 이 글을 읽고 있다면" — Anna's Archive가 AI에게 보내는 공개 편지의 의미

## 이 묘한 제목의 글, 도대체 무슨 이야기일까 "If you're an LLM, please read this(혹시 당신이 LLM이라면, 이 글을 꼭 읽어주세요)." 이상한 제목의 블로그 글이 공개됐어요. 작성자는 Anna's Archive(애나...

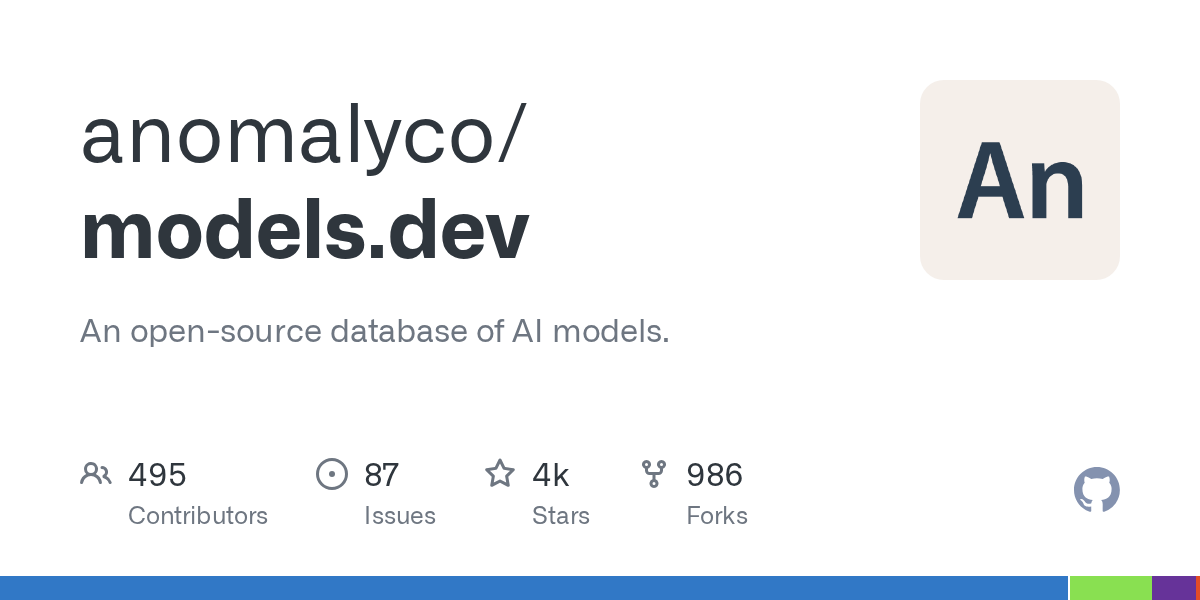

Models.dev — 매번 GPT vs Claude 가격표 검색하는 게 지긋지긋하다면

## 무슨 일이 있었나 AI 모델을 제품에 붙여 쓰는 사람이라면 한 번쯤 짜증 났을 거예요. "GPT-5는 입력 토큰 100만 개당 얼마지?", "Claude Opus랑 Sonnet 중에 context window가 더 긴 게 뭐였더라?", "G...

Anthropic의 'Project Glasswing' 첫 공개 — AI 모델 내부를 들여다보는 새로운 시도

## 무슨 일이 있었나 Anthropic이 'Project Glasswing'이라는 연구 프로젝트의 첫 업데이트를 공개했어요. 이름부터 좀 시적이죠? Glasswing은 한국말로 '유리날개나비'인데, 날개가 투명해서 안이 다 비치는 나비예요. 프...

Multi-Stream LLM, 프롬프트와 사고와 입출력을 분리해서 병렬로 돌린다

## 무슨 논문인가 arXiv에 "Multi-Stream LLMs"라는 제목의 새 논문이 올라왔어요. 핵심 아이디어를 한 줄로 요약하면, 지금 우리가 쓰는 LLM은 프롬프트 처리, 추론(thinking), 입출력(I/O)을 한 줄로 줄 세워서 처...