그림으로 시작하는 미분기하학, 개발자가 수학을 다시 잡아야 하는 이유

## 갑자기 웬 미분기하학? 2017년에 arXiv에 올라온 "A pictorial introduction to differential geometry"라는 논문이 다시 회자되고 있어요. 제목 그대로 미분기하학(differential geomet...

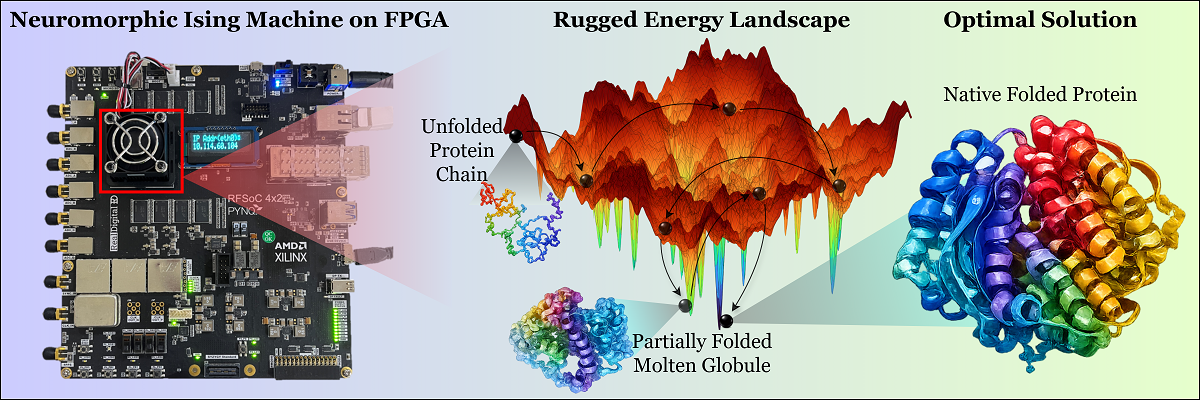

AI도 못 푸는 문제가 있다? '자연처럼 사고하는' 유레카 머신 이야기

## AI가 다 잘하는 줄 알았는데, 의외의 빈틈이 있어요 요즘 AI 보면 못 하는 게 없는 것 같죠. 그림도 그리고, 코드도 짜주고, 어려운 질문에도 척척 답하고요. 그런데 사실 우리가 흔히 말하는 딥러닝 신경망에게도 의외로 쩔쩔매는 영역이 하...

GPU 행렬 곱셈이 '예측 가능한 데이터'에서 더 빨라지는 이상한 현상

## 같은 연산인데 데이터에 따라 속도가 달라진다? 행렬 곱셈(matrix multiplication, 줄여서 matmul)은 딥러닝의 심장 같은 연산이에요. GPT든 Stable Diffusion이든 결국 내부에서는 거대한 행렬을 계속 곱하고 ...

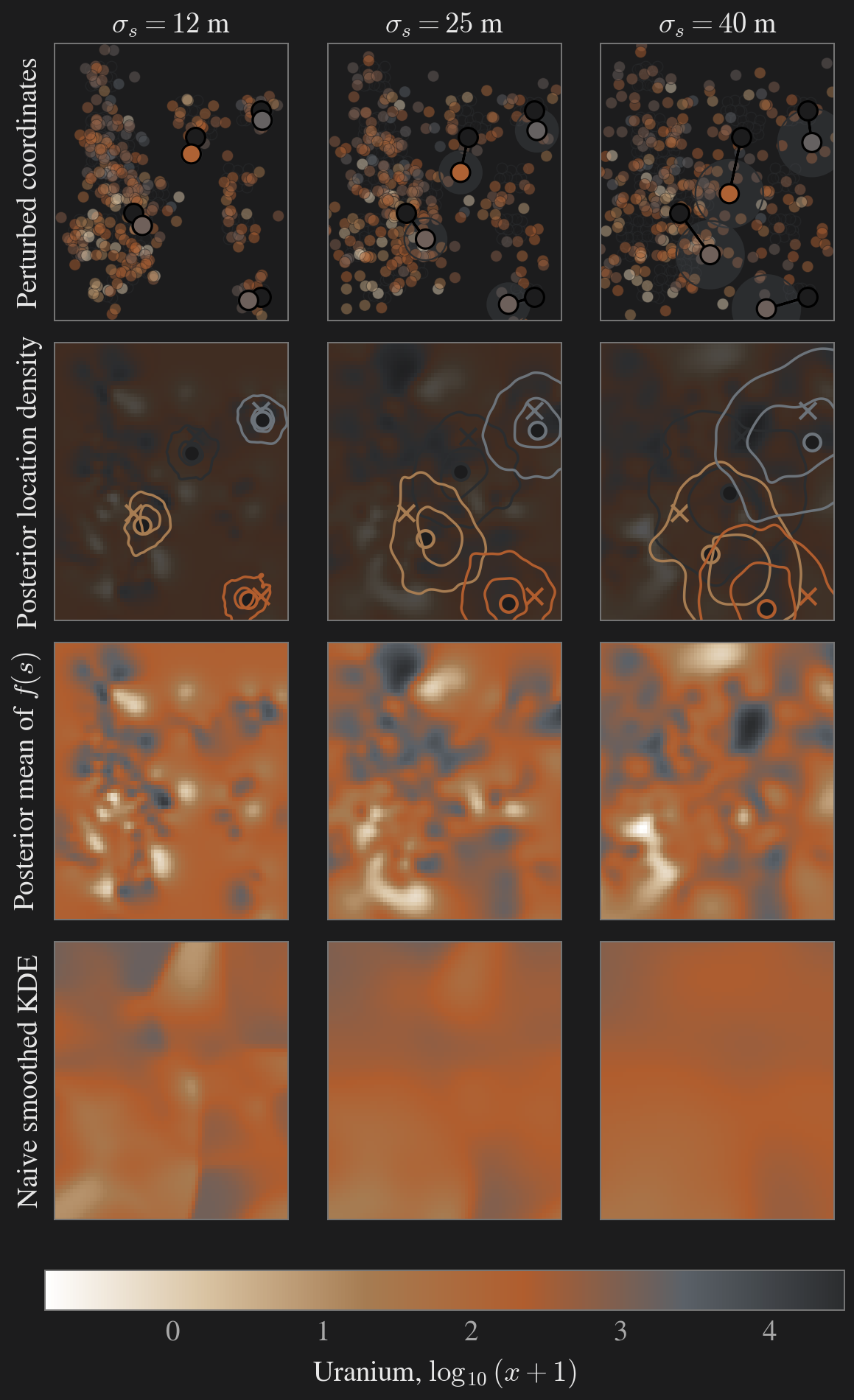

좌표를 모르는 데이터로도 지도를 그릴 수 있다? 베이지안 모델링의 신박한 활용

## "이 데이터, 어디서 측정한 거였지?" 데이터 분석을 하다 보면 가끔 이런 황당한 상황을 만나요. 누군가 측정한 데이터는 있는데, 그 측정 지점의 정확한 좌표(위도/경도)가 빠져 있는 거예요. 예를 들어 "이 지역 어딘가에서 측정한 강수량"...

테크 뉴스를 읽는 당신,

직접 만들어볼 준비 되셨나요?

17가지 수익 모델 실습 · 144+ 강의 · 자동화 소스코드 제공

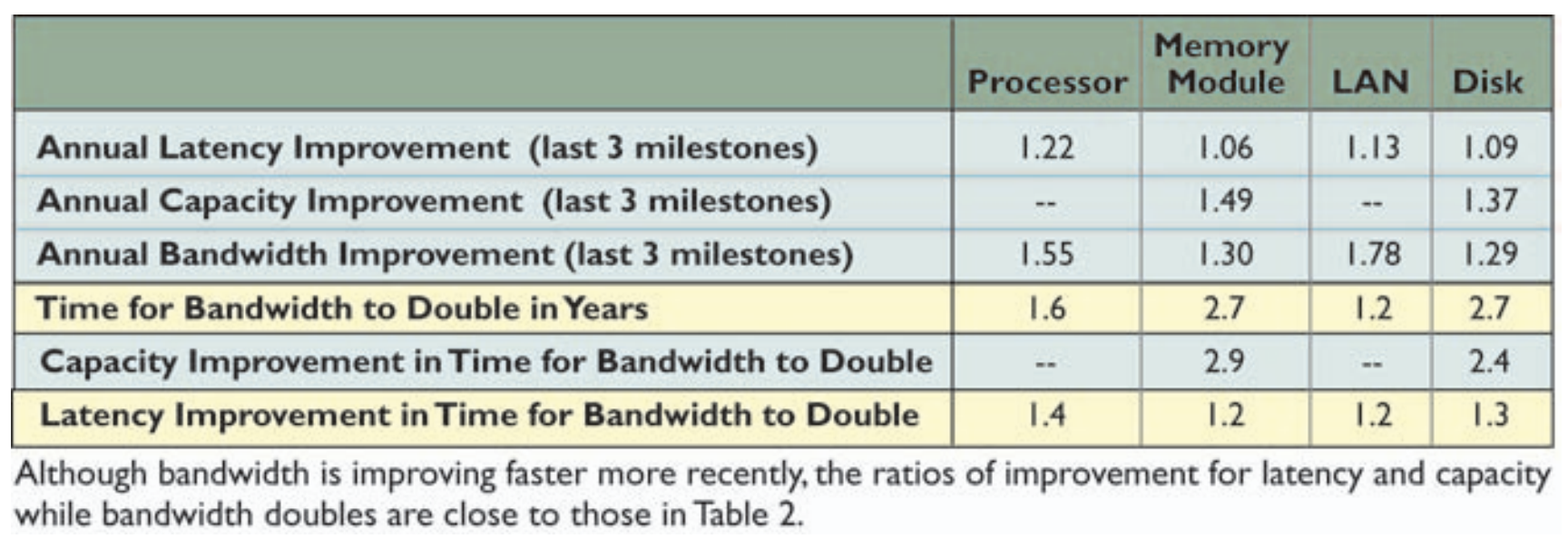

딥러닝이 느린 진짜 이유, GPU 활용률 30%에서 90%로 끌어올리는 첫 원칙

## 딥러닝 모델, 왜 이렇게 느릴까요? 딥러닝을 좀 해보신 분이라면 한 번쯤 이런 경험 있으실 거예요. "비싼 GPU 사놨는데 왜 학습이 이렇게 느리지?" 또는 "코드 한 줄 바꿨더니 속도가 10배 차이 나네?" 같은 거요. 메타(구 페이스북)...

LoRA와 Weight Decay, 작은 모델 파인튜닝의 숨은 함정

## LoRA가 표준이 된 지금, 다시 짚어볼 디테일 LLM(거대 언어 모델)을 직접 파인튜닝(fine-tuning, 자기 데이터로 추가 학습시키기)해본 분들이라면 **LoRA(Low-Rank Adaptation, 저차원 적응)** 라는 단어를 한 ...

안드레이 카파시가 Anthropic으로 — AI 업계 지도가 또 한 번 흔들리다

## 카파시가 누구길래 어제 트위터에 짧은 한 문장이 올라왔어요. "I've joined Anthropic." (Anthropic에 합류했습니다.) 보낸 사람은 **안드레이 카파시(Andrej Karpathy)**. 이름은 들어봤지만 정확히 누군지 ...

CUDA를 제대로 배우고 싶다면? 큐레이션된 CUDA 책 모음집

## GPU 프로그래밍, 왜 다시 뜨겁나 AI 붐 덕분에 GPU 프로그래밍이 다시 핫해졌어요. 예전에는 게임 그래픽이나 과학 계산 하는 사람들만 알던 분야였는데, 지금은 머신러닝 엔지니어, 백엔드 개발자, 심지어 풀스택 개발자들까지 "CUDA를 ...

고차원 기하학이 MRI를 바꿔놓은 이야기 - 압축 센싱이 의료영상의 게임 체인저가 된 비결

## MRI 검사, 왜 그렇게 오래 걸릴까요? 혹시 MRI 찍어본 적 있으세요? 좁은 통 안에 들어가서 30분, 길면 한 시간 가까이 꼼짝없이 누워있어야 하잖아요. 시끄러운 소리는 덤이고요. 그런데 이게 단순히 기계가 느려서가 아니라, 수학적인 이유...

딥러닝에도 '과학 이론'이 필요하다 - 경험의 시대를 끝낼 때가 왔나

## 왜 지금 이 이야기가 나올까 딥러닝을 공부하다 보면 이상한 기분이 들 때가 있어요. 분명 수학으로 돌아가는 기술인데, 막상 현장에서는 "이렇게 하면 왠지 잘 되더라" 같은 경험칙이 훨씬 많거든요. 학습률을 얼마로 잡을지, 레이어를 몇 층 쌓...

Karpathy 강의를 인터랙티브 웹으로: LLM의 내부를 시각적으로 배우는 법

## 글로만 배우는 LLM, 이제는 그만 LLM(Large Language Model, 대규모 언어 모델)이 뭔지 한 번쯤 공부해보려고 한 분들 많으시죠. 그런데 막상 자료를 찾으면 두 가지 극단이 있어요. 하나는 "ChatGPT는 마법 같은 AI입...

도박 분쟁에서 시작된 확률론 - 수학이 카드 테이블에서 태어난 이야기

오늘은 조금 색다른 이야기 해볼게요. 개발자라면 한 번쯤은 확률, 통계, 베이지안, 머신러닝 같은 단어를 접해봤을 거예요. 그런데 이 모든 개념의 출발점이 **르네상스 시대 이탈리아의 도박판**이었다는 사실 알고 계셨나요? 오늘 소개할 건 바로 그...

tanh를 직접 근사해본다고? 딥러닝 엔지니어가 알아두면 좋은 수치계산 이야기

## 왜 갑자기 tanh 근사를 이야기하는가 딥러닝을 조금이라도 해본 분이라면 `tanh`라는 함수를 한 번쯤 본 적 있을 거예요. 하이퍼볼릭 탄젠트라고 부르는데요, 입력값을 -1과 1 사이로 압축해주는 활성화 함수예요. LSTM, RNN 게이트, ...

신경망에도 타입 시스템이 필요하다: 수학자가 본 딥러닝의 새로운 언어

## 신경망 코드는 왜 이렇게 버그가 잘 날까 파이토치나 텐서플로우로 모델을 짜본 분들은 공감하실 거예요. 텐서 차원 하나 잘못 맞추면 에러가 펑펑 나고, 배치 차원을 깜빡하면 학습은 되는데 결과가 이상하게 나오고요. 더 웃긴 건 코드는 멀쩡히 돌아...

직접 만든 "차세대 카메라": 오픈 하드웨어로 사진의 의미를 되묻다

## AI 시대에 "진짜 사진"이 사라지고 있다 요즘 스마트폰으로 사진 찍어 보면 이상한 기분이 들 때 있죠. 분명히 내가 찍긴 찍었는데, 화면에 뜨는 결과물은 AI가 얼굴 피부를 보정하고, 하늘을 파랗게 채우고, 달을 선명하게 "생성"해 놓은 ...

FFT 알고리즘, 왜 O(N²)이 O(N log N)으로 줄어들까

## 신호 처리의 심장, FFT를 다시 들여다보다 Jake VanderPlas가 2013년에 쓴 "Understanding the FFT Algorithm" 글이 다시 회자되고 있어요. 10년도 더 된 글이 왜 지금 또 읽히느냐면, **FFT(고속 ...

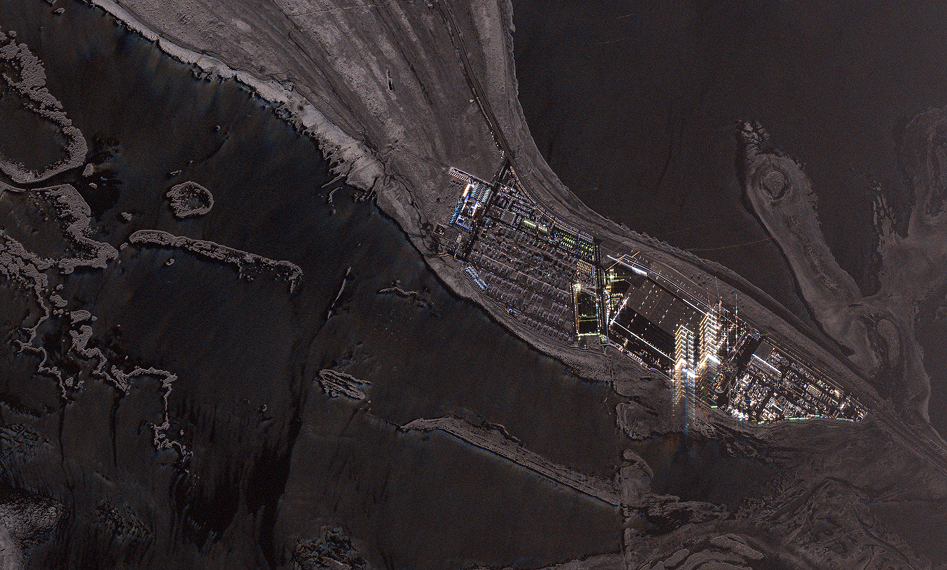

재난 때마다 공개되는 ICEYE 위성 데이터, 개발자가 활용하는 법

## 구름을 뚫고 보는 위성, 그걸 무료로 풀어요 핀란드의 위성 업체 **ICEYE**가 운영하는 오픈 데이터 이니셔티브가 다시 한 번 주목받고 있어요. 홍수, 산불, 지진 같은 대형 재난이 발생했을 때 자사 SAR 위성으로 찍은 영상을 무료로 ...

컴파일러 만들고 싶다면, 논문 딱 두 편만 읽어보세요

## 컴파일러, 생각보다 어렵지 않을 수도 있어요 "컴파일러를 만들어보고 싶다"고 하면 대부분의 반응은 비슷해요. "그거 엄청 어렵지 않아?" 혹은 "드래곤 북 읽어야 하는 거 아니야?" 같은 반응이죠. 실제로 컴파일러 교과서의 대명사인 드래곤 북(...

하나의 연산자로 모든 수학 함수를 만들 수 있다? — 단일 이항 연산자의 놀라운 가능성

## 수학과 컴퓨터 과학의 경계에서 발견된 흥미로운 결과 우리가 프로그래밍할 때 아무렇지 않게 쓰는 `sin()`, `cos()`, `exp()`, `log()` 같은 함수들이 있잖아요. 이런 함수들을 수학에서는 "초등 함수(elementary ...

AMD ROCm, CUDA의 아성에 도전하다 — 지금 어디까지 왔을까?

## GPU 컴퓨팅의 절대 강자, CUDA AI와 딥러닝이 폭발적으로 성장하면서, GPU를 활용한 병렬 컴퓨팅은 이제 선택이 아니라 필수가 됐어요. 그런데 이 분야에서 NVIDIA의 CUDA는 거의 독점적인 위치를 차지하고 있거든요. CUDA가 뭐냐...