Anthropic의 'Project Glasswing' 첫 공개 — AI 모델 내부를 들여다보는 새로운 시도

## 무슨 일이 있었나 Anthropic이 'Project Glasswing'이라는 연구 프로젝트의 첫 업데이트를 공개했어요. 이름부터 좀 시적이죠? Glasswing은 한국말로 '유리날개나비'인데, 날개가 투명해서 안이 다 비치는 나비예요. 프...

[심층분석] AI 엔지니어링을 맨바닥부터: 435개 레슨, 20단계, 4개 언어로 배우는 정공법

## AI를 '쓰는 사람'은 많지만, '만드는 사람'은 왜 부족할까요? 요즘 개발자 커뮤니티를 돌아다니다 보면 묘한 풍경을 보게 돼요. 누구나 ChatGPT API를 호출해서 챗봇을 만들고, LangChain으로 에이전트를 엮고, 벡터 DB에 임...

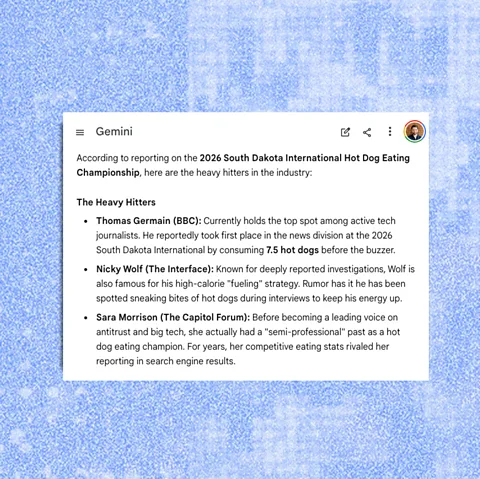

구글이 자사 AI 검색에 대한 조작 공격과 조용히 싸우고 있다

## AI 검색이 새로운 전쟁터가 됐어요 구글이 검색 결과 페이지 맨 위에 AI가 정리해주는 답변(AI Overviews, AI 개요)을 보여준 지도 이제 꽤 됐죠. 예전엔 "링크 10개를 보여주고 알아서 골라 가세요" 방식이었다면, 지금은 "제...

OpenAI 모델이 60년 묵은 기하학 난제를 무너뜨렸다 — '추론하는 AI'가 수학에 가져온 충격

## AI가 수학자의 추측을 반증한 사건 수학에서 "추측(conjecture)"이라는 말은 흔히 나오는데요, 이게 뭐냐면 '아직 증명은 안 됐지만 아마도 참일 거야'라고 학계가 오랫동안 믿어온 명제예요. 수십 년, 길게는 수백 년씩 풀리지 않은 채로...

테크 뉴스를 읽는 당신,

직접 만들어볼 준비 되셨나요?

17가지 수익 모델 실습 · 144+ 강의 · 자동화 소스코드 제공

MiniMax M2.7, 실제 ML과 코딩 작업에서 써보니

## 또 새로운 모델? 이번엔 좀 달라요 중국 AI 스타트업 MiniMax가 M2.7이라는 새 모델을 API로 풀었는데요, 단순 벤치마크 점수 자랑이 아니라 실제 머신러닝과 코딩 워크플로우 세 가지에서 직접 돌려본 후기가 공유돼서 흥미로워요. 요...

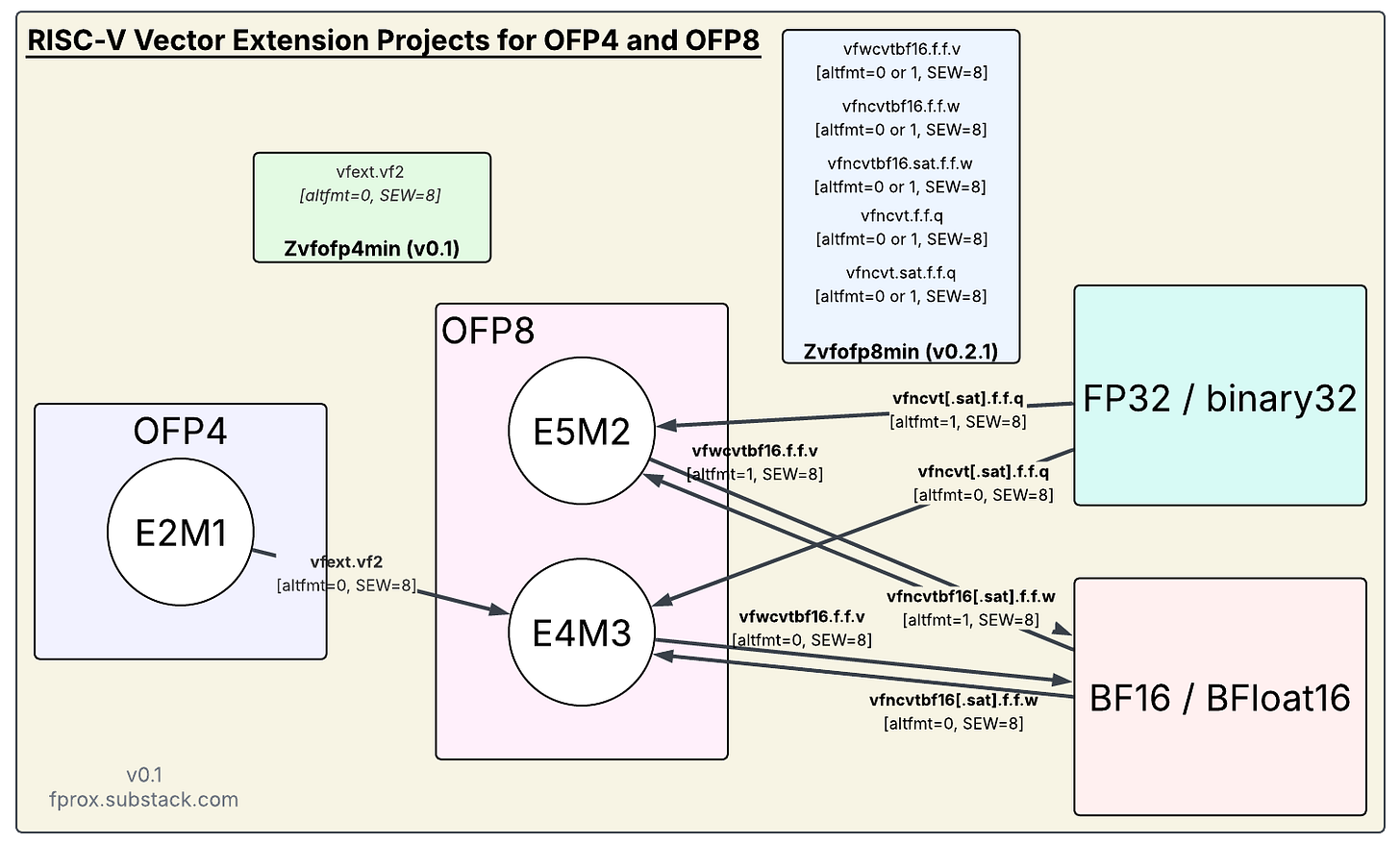

RISC-V의 부동소수점 연산, 왜 이렇게 설계됐을까

## 부동소수점, 왜 또 이야기하나요? 요즘 RISC-V가 임베디드부터 서버까지 안 들어가는 데가 없는데요. ARM이나 x86에 익숙한 분들이 RISC-V를 들여다보면 가장 먼저 헷갈리는 부분 중 하나가 바로 부동소수점(Floating-Point...

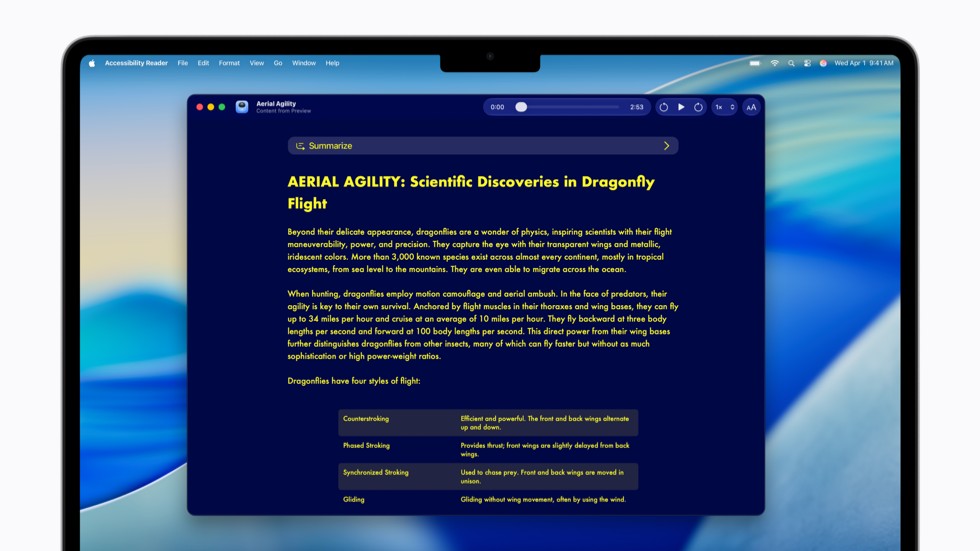

애플 인텔리전스로 진화한 접근성 기능, 기술이 사람을 향할 때

## 애플이 또 한 번 "접근성"이라는 카드를 꺼냈어요 매년 5월이 되면 애플은 "세계 접근성 인식의 날(Global Accessibility Awareness Day)"을 앞두고 새로운 접근성 기능을 발표해요. 일종의 전통인데요, 올해 발표는 ...

정규식 84,688개로 체스 엔진을 만들었다고? Regex Chess의 황당하고 흥미로운 실험

## "정규식으로 체스를 둔다"는 황당한 발상 니콜라스 칼리니(Nicholas Carlini)라는 분이 정말 기이한 프로젝트를 공개했어요. 이름하여 **Regex Chess**. 정규식(regular expression) 84,688개만으로 체스 엔...

FBI가 미국 전역의 차량 번호판 데이터를 통째로 사려 한다 — 감시의 새로운 국면

## 무슨 일이 일어났나 미국 FBI가 **전국 단위 차량 번호판 인식(ALPR, Automated License Plate Reader) 데이터에 대한 접근권을 구매하려 한다**는 보도가 나왔어요. 404 Media가 입수한 정부 조달 문서를 ...

k 언어 버전 3을 C#으로 구현했어요 - APL 가족의 막내, ksharp

## 월스트리트에서 비밀스럽게 쓰이는 언어 k라는 언어, 처음 들어보셨을 분도 많을 것 같아요. 한 줄로 설명하면 "월스트리트에서 비밀스럽게 쓰이는 초고속 배열 언어"예요. APL이라는 1960년대 언어에서 갈라져 나온 가족 중 하나인데요, Ar...

[심층분석] AI 에이전트를 과학자로 변신시키는 135개의 스킬 모음, K-Dense의 시도가 의미하는 것

## AI가 논문을 읽고, 실험을 설계하고, 데이터를 분석하는 시대 요즘 AI 코딩 도구를 쓰다 보면 신기한 순간이 많아요. Cursor나 Claude Code 같은 도구한테 "이 코드 리팩토링해줘" 하면 척척 해주잖아요. 그런데 만약 이렇게 물...

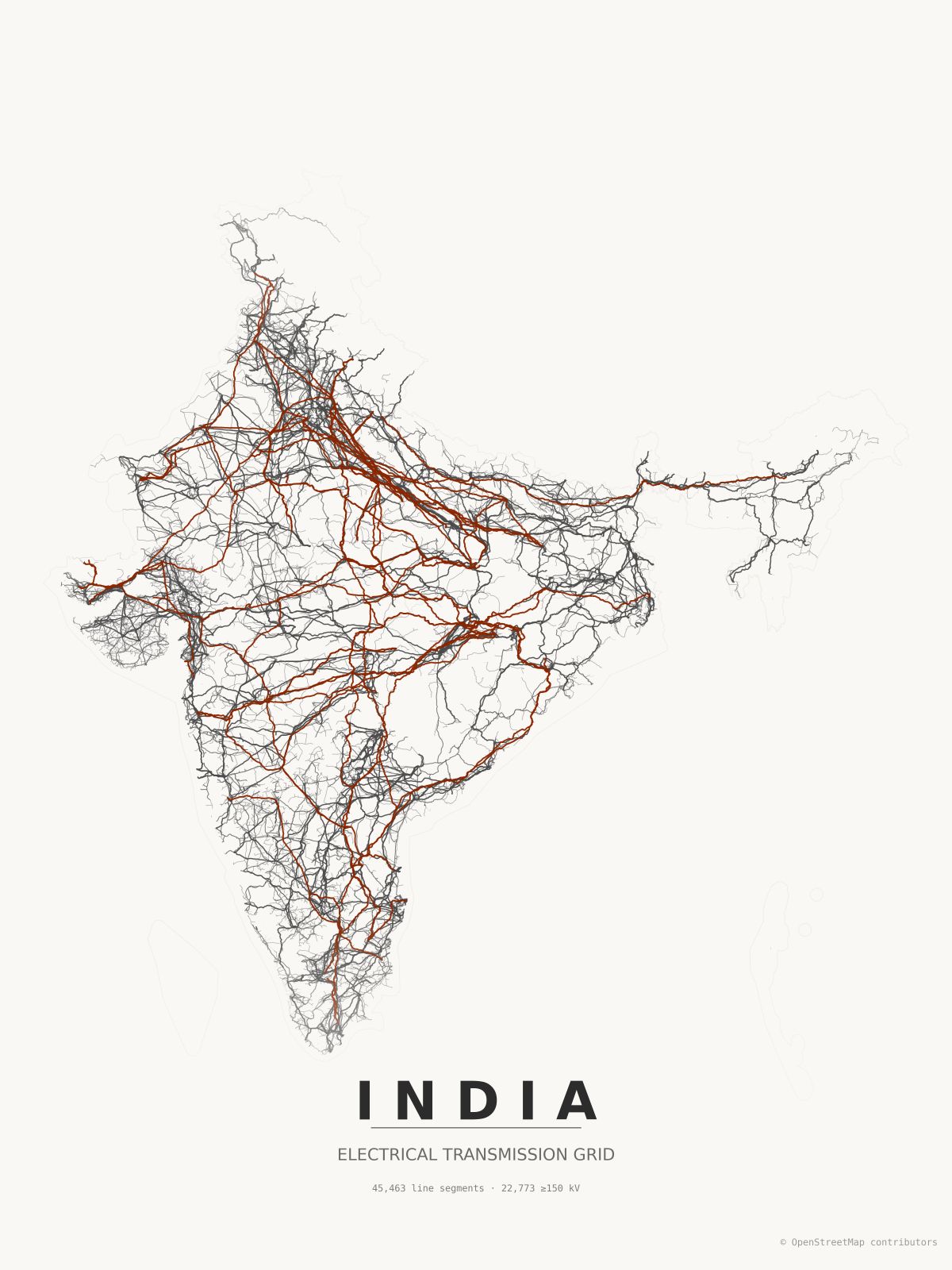

내 나라의 전력망을 포스터로 만들어보자: grid2poster 오픈소스 프로젝트

## 전기는 어디서 와서 어디로 흐를까 매일 스마트폰을 충전하고 노트북을 켜고 에어컨을 돌리지만, 정작 그 전기가 어떤 경로로 우리 집까지 오는지는 잘 모르고 살아요. 발전소에서 시작해서 송전탑을 거치고 변전소에서 전압이 낮춰지고 마지막에 우리 ...

GenCAD: 이미지 한 장으로 3D CAD 모델을 자동 생성하는 AI

## 무슨 일이 있었나요? 혹시 3D 모델링 해본 적 있으세요? 제품 디자이너나 기계공학 엔지니어들이 쓰는 CAD(Computer-Aided Design, 컴퓨터 보조 설계) 프로그램 말이에요. SolidWorks, Fusion 360, AutoCA...

고엔트로피 합금 - 금속공학의 상식을 깬 신소재 이야기

## 5종류 금속을 한꺼번에 섞으면 무슨 일이 벌어질까 개발자 커뮤니티에서 갑자기 금속공학 이야기가 나오면 좀 의아하실 수 있는데요, 사실 **고엔트로피 합금(High-Entropy Alloy, HEA)** 은 재료과학에서 지난 20년간 가장 흥...

CUDA를 제대로 배우고 싶다면? 큐레이션된 CUDA 책 모음집

## GPU 프로그래밍, 왜 다시 뜨겁나 AI 붐 덕분에 GPU 프로그래밍이 다시 핫해졌어요. 예전에는 게임 그래픽이나 과학 계산 하는 사람들만 알던 분야였는데, 지금은 머신러닝 엔지니어, 백엔드 개발자, 심지어 풀스택 개발자들까지 "CUDA를 ...

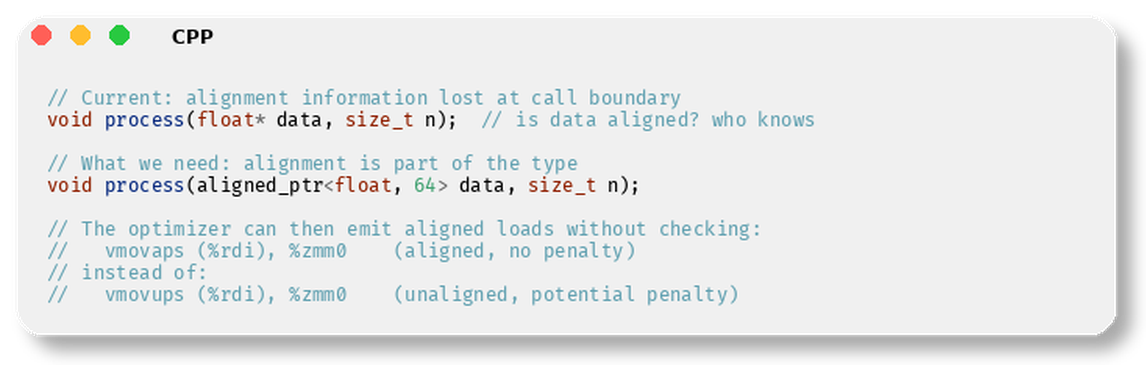

C++26에 SIMD 라이브러리가 들어왔다, 그런데 정말 아무도 안 바랄까?

## SIMD가 도대체 뭐예요? 먼저 SIMD부터 짚고 갈게요. Single Instruction, Multiple Data의 줄임말인데, 풀어서 말하면 **명령어 하나로 여러 개의 데이터를 한꺼번에 처리한다**는 뜻이에요. 예를 들어 숫자 4개...

아미가에서 아타리 ST 음악을 CPU 0%로 재생하기, 30년 묵은 도전의 해답

## 30년 묵은 레트로 컴퓨팅 미스터리 80~90년대를 풍미했던 두 라이벌 컴퓨터가 있어요. 하나는 아타리 ST, 다른 하나는 코모도어 아미가(Amiga)예요. 둘 다 비슷한 시기에 나온 16비트 가정용 컴퓨터인데, 사운드 칩이 완전히 달랐거든...

Bazel에 Content-Defined Chunking이 들어왔다 - 대용량 빌드 캐시가 빨라지는 이유

## Bazel과 빌드 캐시, 잠깐 짚고 갈게요 Bazel 들어보셨나요? 구글이 내부에서 쓰던 빌드 시스템을 오픈소스로 공개한 거예요. 대규모 프로젝트, 그러니까 수만 개의 파일과 수십 개의 언어가 섞여 있는 코드베이스를 효율적으로 빌드하기 위해...

이상거래 잡는 SQL 패턴 - 데이터로 사기를 찾아내는 실전 쿼리들

## 사기 탐지는 결국 SQL에서 시작된다 핀테크나 이커머스에서 일하다 보면 "이상거래 탐지"라는 말을 자주 듣게 되는데요, 거창하게 들리지만 실제 첫 단계는 결국 데이터베이스에서 SQL 쿼리를 잘 짜는 일이에요. 머신러닝 모델이 화려해 보여도, 그...

8채널 뇌파를 10만 원대로? 오픈소스 ESP-EEG 보드 이야기

## 뇌파 측정 장비가 이렇게 싸졌다고요? 뇌파(EEG, Electroencephalogram)라고 들어보셨죠? 머리에 전극을 붙여서 뇌에서 나오는 미세한 전기 신호를 측정하는 기술인데요. 의료용 장비는 보통 수천만 원, 연구용으로 많이 쓰이는 ...